机器学习 day04(梯度下降算法)

- 梯度下降

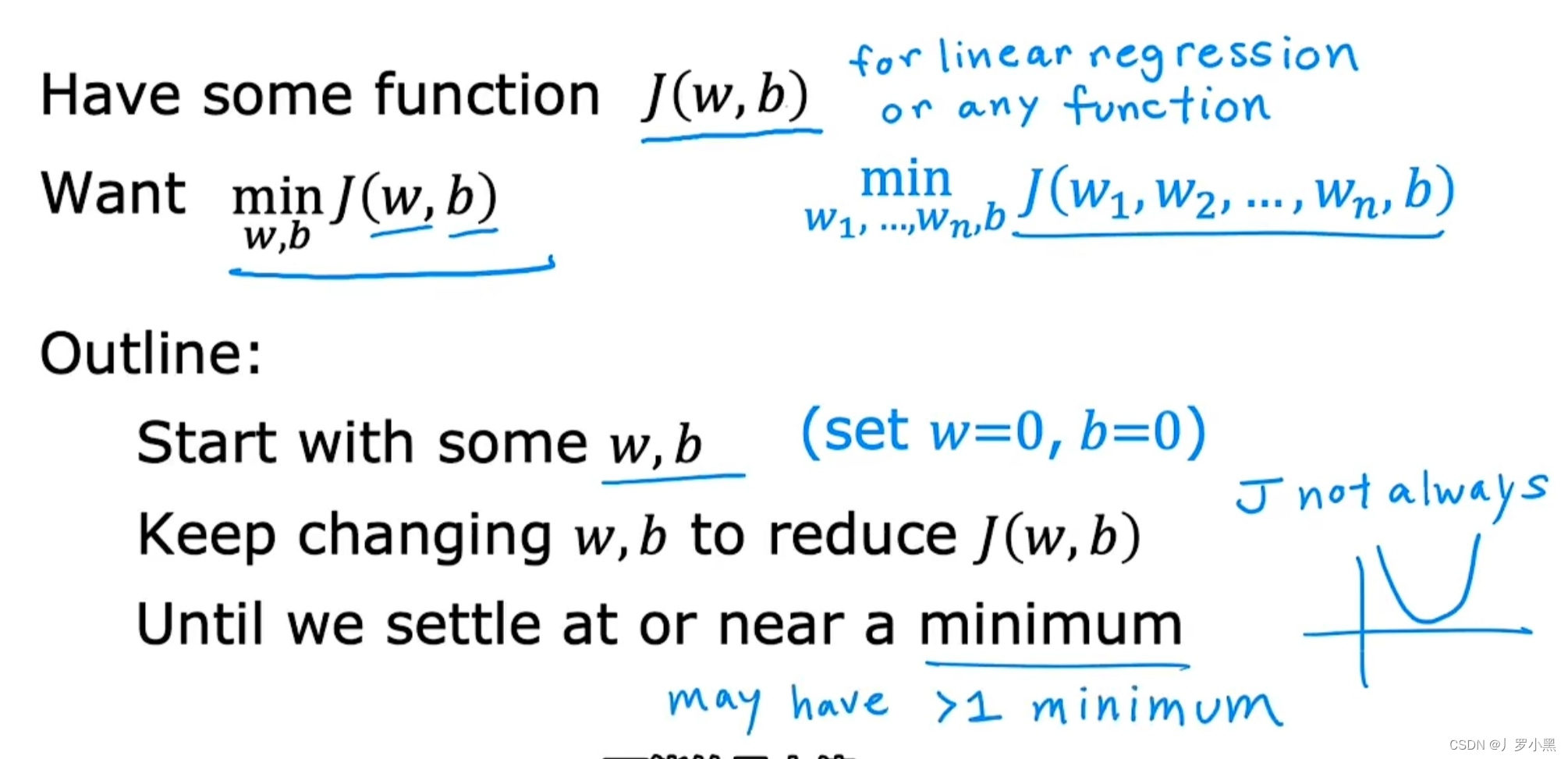

- 我们可以用一种更系统的方法,来找到一组w,b,使成本函数的值最小。这个方法叫梯度下降算法,它可用于最小化任何函数,不仅仅包括线性回归的成本函数,也包括两个以上参数的其他成本函数

- 在线性回归中,w和b的初始值是多少并不重要,所以通常将他们的初始值设为0。

- 成本函数并不总是弓形或吊床行的函数,这代表他可能有两个及以上的最小值

- 梯度下降算法的步骤:

a. 初始化w和b的值,通常设为0

b. 继续更改w和b的值,来降低J函数的值

c. 直到J函数到达,或接近J函数的最小值

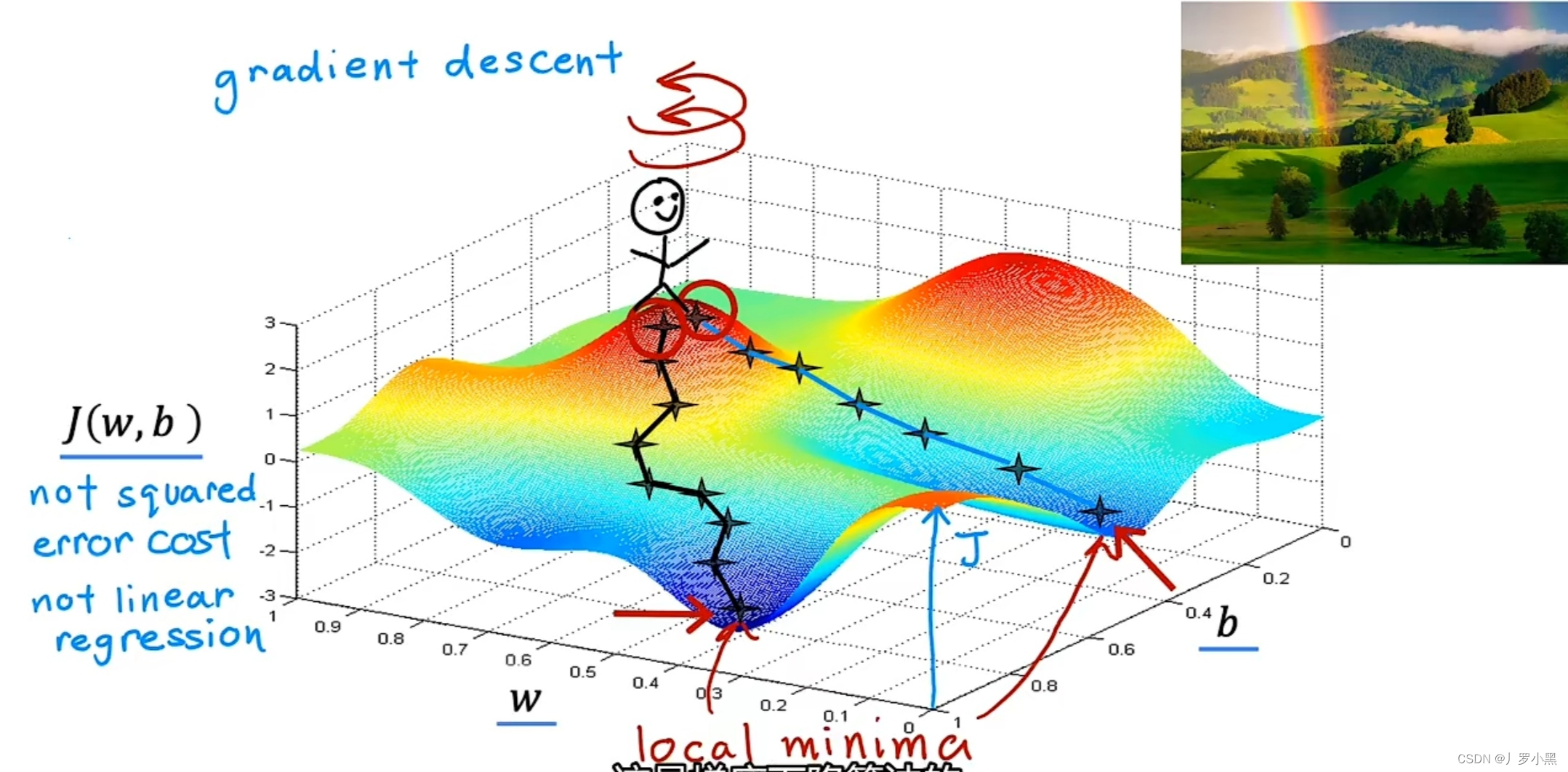

- 深度学习模型的成本函数

-

梯度下降算法的步骤:

a. 选取一组w和b作为初始位置

b. 站在初始位置上,旋转360°,找到一个最高效下到这些山谷之一的底部的方向,并迈出一小步。从数学上来讲,这个方向是最陡下降方向

c. 站在迈出一小步后的位置上,并重复上一步的过程

d. 站在下一个位置上,重复上一步的过程

…

e. 直到发现自己站在山谷的底部,而这个J函数的局部最小值就在这 -

梯度下降的特性:当我们更改w和b的初始值后,会得到一个不同的局部最小值