决策树和随机森林

目录

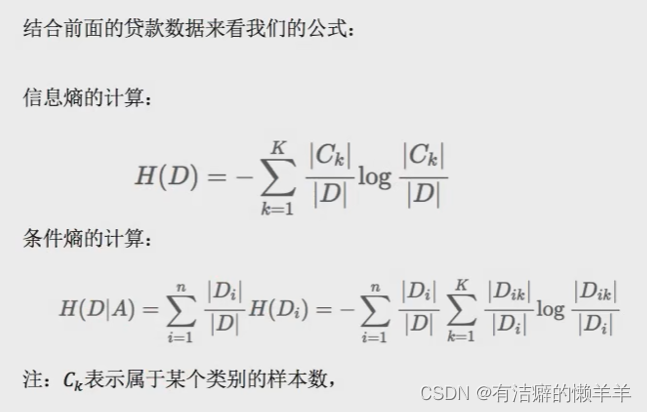

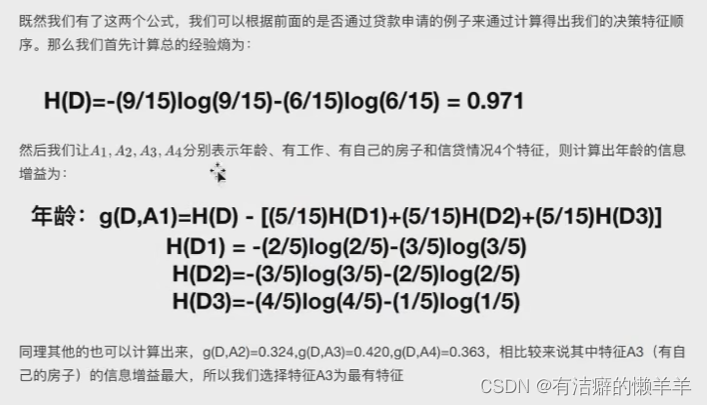

信息熵

决策树的划分依据之一-信息增益

信息论基础-银行贷款分析

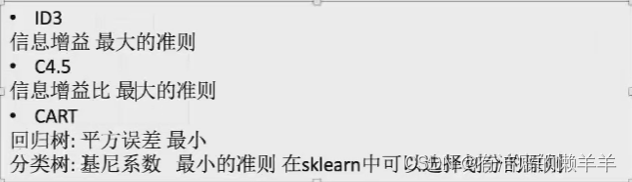

常见决策树使用的算法

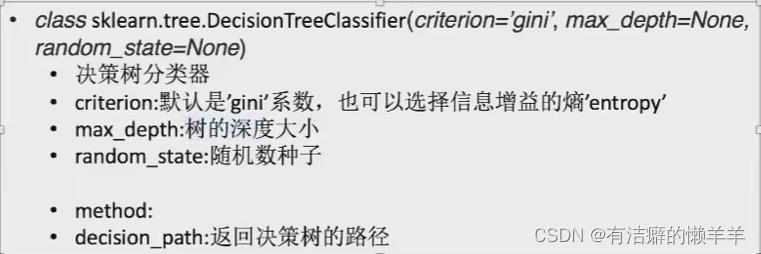

sklearn 决策树API

泰坦尼克号乘客生存分类

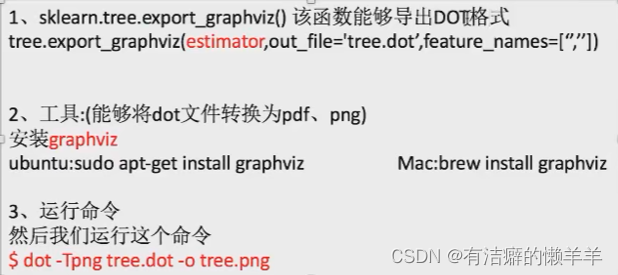

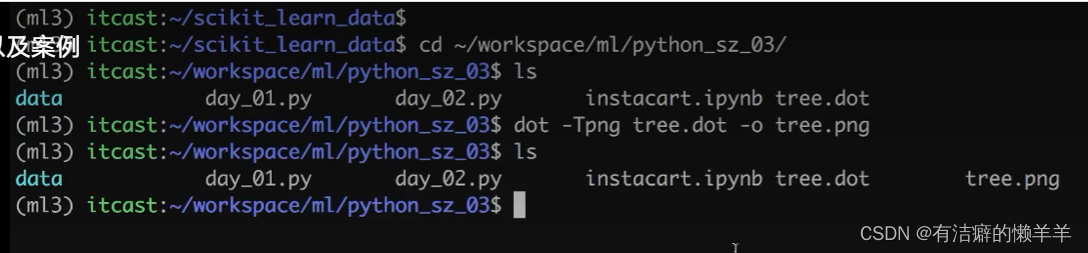

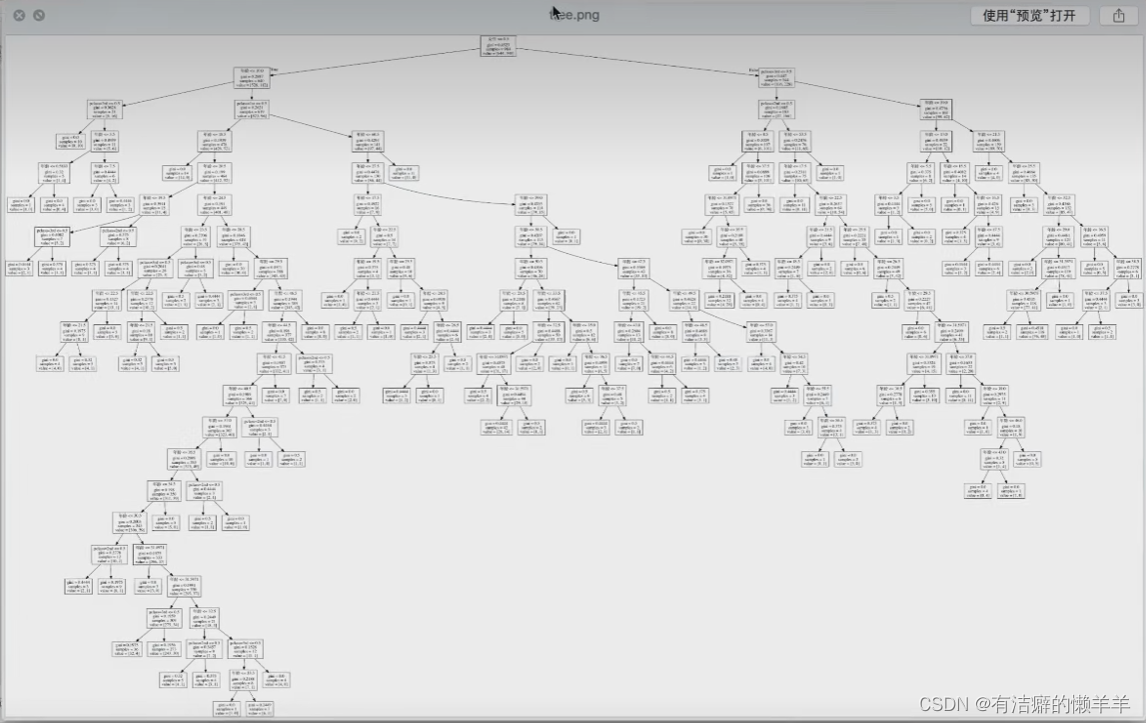

决策树的结构、本地保存

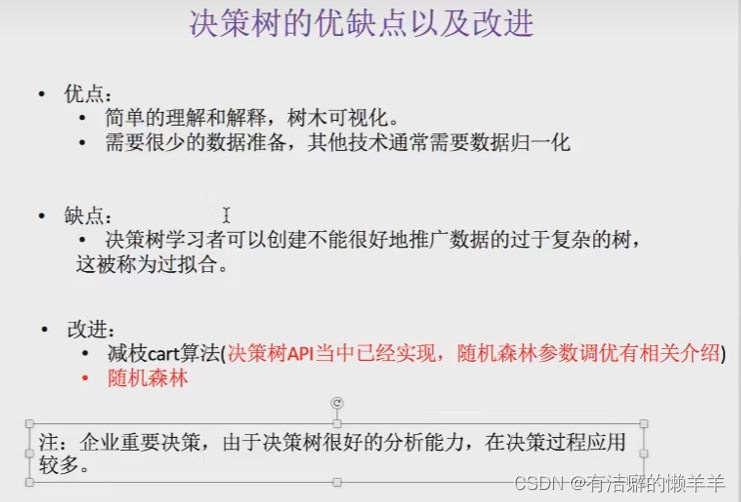

决策树的优缺点以及改进

集成学习方法-随机森林

随机森林API

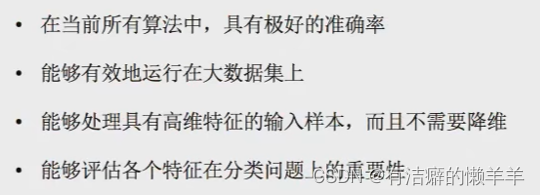

随机森林的优点

决策树

决策树思想的来源非常朴素,程序设计中的条件分支结构就是if-then结构,最早的决策树就是利用这类结构分割数据的一种分类学习方法

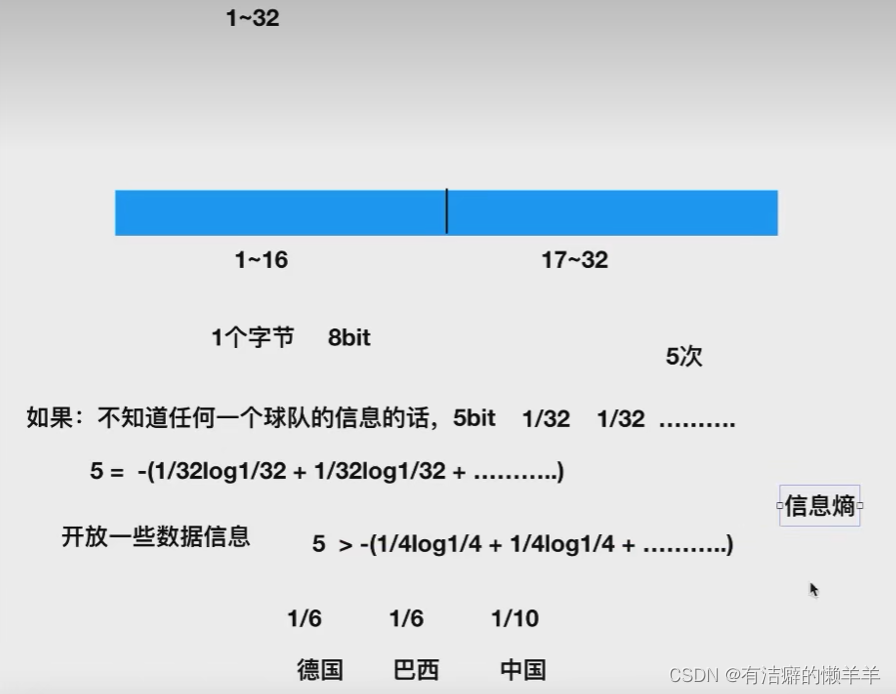

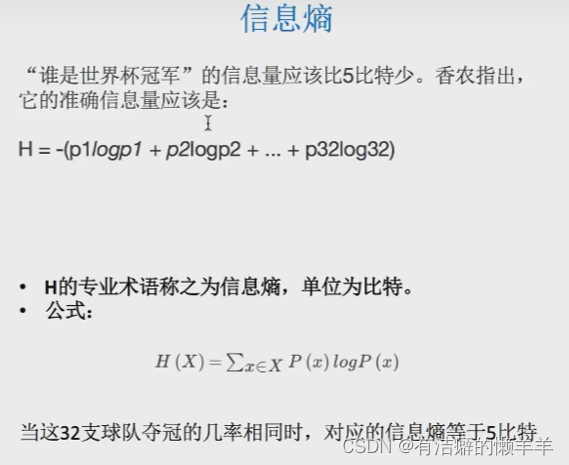

信息熵

信息和消除不确定性是相联系的

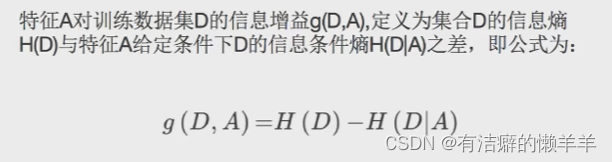

决策树的划分依据之一-信息增益

信息增益:当得知一个特征条件之后,减少信息熵的大小

注意:信息增益表示得知特征X的信息而使得类Y的信息的不确定性减少的程度

信息论基础-银行贷款分析

常见决策树使用的算法

基尼系数:划分更加仔细

sklearn 决策树API

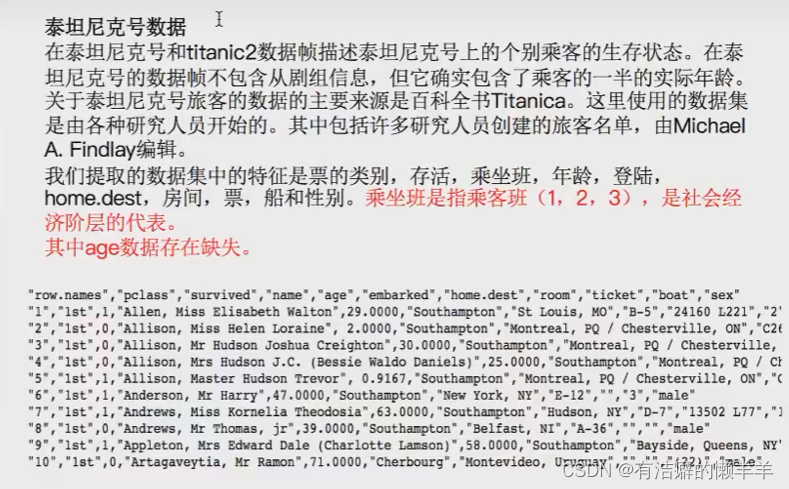

泰坦尼克号乘客生存分类

构建模型:1.pd读取数据 2.选择有影响的特征,处理缺失值 3.进行特征工程,pd转换字典,特征抽取x_train.to_dict(orient="records") 4.决策树估计器流程

from sklearn.feature_extraction import DictVectorizer

from sklearn.tree import DecisionTreeClassifier, export_graphviz()def decision():"""决策树对泰坦尼克号进行预测生死"""# 获取数据titan = pd.read_csv("http://biostat.mc.vanderbilt.edu/wiki/pub/Main/DataSets/titanic.txt")# 处理数据, 找出特征值和目标值x = titan['pclass','age','sex']y = titan['survived']print(x)# 缺失值处理x['age'].fillna(x['age'].mean(), inplace=True)# 分割数据集到训练集和测试集x_train, x_test, y_train, y_test = train_test_split(x,y,test_size=0.25)# 进行处理(特征工程)特征-》类别-》one_hot编码dict = DictVectorizer(sparse=False)x_train = dict.fit_transform(x_train.todict(orient="records"))print(dict.get_feature_names())x_test = dict.transform(x_test.todict(orient="records"))print(x_train)# 用决策树进行预测dec = DecisionTreeClassifier(max_depth=8)#dec = DecisionTreeClassifier(max_depth=5)dec.fit(x_train, y_train)# 预测准确率print("预测准确率:", dec.score(x_test, y_test))# 导出决策树的结构export_graphviz(dec,out_file="./tree.dot",feature_names=['年龄','pclass=1st','pclass=2nd','pclass=3rd','sex=female','sex=male']return Noneif _name_ == "_main_":decision()决策树的结构、本地保存

决策树的优缺点以及改进

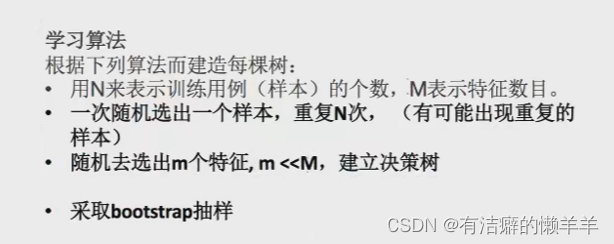

集成学习方法-随机森林

集成学习:集成学习通过建立几个模型组合的来解决单一预测问题。它的工作原理是生成多个分类器/模型,各自独立地学习和做出预测。这些预测最后结合成单预测,因此优于任何一个单分类的做出预测。

随机森林:在机器学习中,随机森林是一个包含多个决策树的分类器,并且其输出的类别是由个别树输出的类别的众数而定。

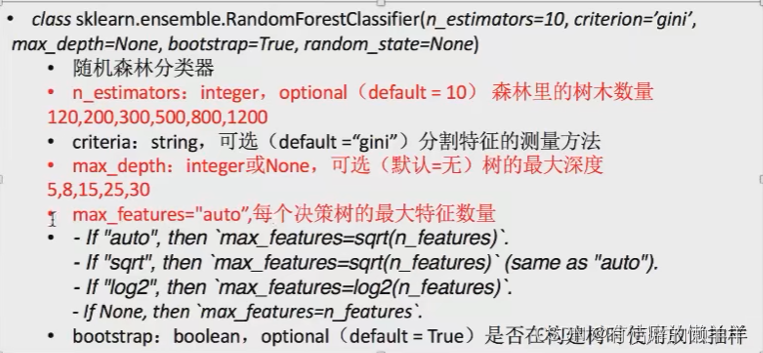

随机森林API

from sklearn.feature_extraction import DictVectorizer

from sklearn.tree import DecisionTreeClassifier, export_graphviz()

from sklearn.ensemble import RandomForestClassifierdef decision():"""决策树对泰坦尼克号进行预测生死"""# 获取数据titan = pd.read_csv("http://biostat.mc.vanderbilt.edu/wiki/pub/Main/DataSets/titanic.txt")# 处理数据, 找出特征值和目标值x = titan['pclass','age','sex']y = titan['survived']print(x)# 缺失值处理x['age'].fillna(x['age'].mean(), inplace=True)# 分割数据集到训练集和测试集x_train, x_test, y_train, y_test = train_test_split(x,y,test_size=0.25)# 进行处理(特征工程)特征-》类别-》one_hot编码dict = DictVectorizer(sparse=False)x_train = dict.fit_transform(x_train.todict(orient="records"))print(dict.get_feature_names())x_test = dict.transform(x_test.todict(orient="records"))# print(x_train)# # 用决策树进行预测# dec = DecisionTreeClassifier(max_depth=8)# #dec = DecisionTreeClassifier(max_depth=5)# dec.fit(x_train, y_train)# # 预测准确率# print("预测准确率:", dec.score(x_test, y_test))# # 导出决策树的结构# export_graphviz(dec,out_file="./tree.dot",feature_names=['年龄','pclass=1st','pclass=2nd','pclass=3rd','sex=female','sex=male']# 随机森林进行预测 (超参数调优)rf = RandomForestClassifier(n_estimators=,max_depth=)params = {"n_estimators":[120,200,300,500,800,1200], "max_depth":[5,8,15,25,30]}# 网格搜索与交叉验证gc = GridSearchCV(rf, param_grid=param, cv=2)gc.fit(x_train, y_train)print("准确率:", gc.score(x_test, y_test))print("查看选择的参数模型:", gc.best_params_)return Noneif _name_ == "_main_":decision()随机森林的优点